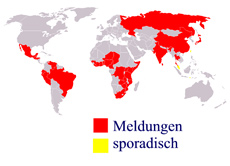

Vereinigte Staaten von Amerika

Die Vereinigten Staaten von Amerika sind ein Land in Nordamerika . Man nennt sie auch kurz Vereinigte Staaten oder USA. Das kommt vom englischen Namen „United States of America“. Viele Leute sagen auch nur „ Amerika “, das ist aber ein Kontinent , der noch größer ist.

Aus dem Inhalt:

[...] liegen, lebten vorher Indianer . Etwa seit dem 17. Jahrhundert kamen immer mehr Menschen aus Europa , um hier in Kolonien zu wohnen, vor allem aus Großbritannien . [...]

https://klexikon.zum.de/wiki/USA